Non è chiaro se anche la campagna anti-falsa della Malesia sia supportata dalla scienza comportamentale. AP Photo / Vincent Thian

CEO di Facebook Mark Zuckerberg recentemente riconosciuto la responsabilità della sua azienda nel contribuire a creare l'enorme quantità di notizie false che hanno afflitto le elezioni di 2016 - dopo smentite precedenti. Tuttavia non ha fornito dettagli concreti su cosa Facebook potesse fare al riguardo.

Fortunatamente, c'è un modo per combattere le notizie false che già esistono e ha la scienza comportamentale dalla sua parte: il Impegno pro-verità progetto.

I faceva parte di un team di scienziati comportamentali che ha avuto l'idea di un impegno come un modo per limitare la diffusione della disinformazione online. Due studi che hanno provato a valutarne l'efficacia suggeriscono che funzioni davvero.

Combattere notizie false

Un numero crescente di legislatori e cittadini ordinari americani ritiene che le società di social media come Facebook e Twitter debbano fare di più per combattere la diffusione di notizie false, anche se si traduce in censura.

A recente indagine, ad esempio, ha dimostrato che 56 percento degli intervistati afferma che le società tecnologiche "dovrebbero adottare misure per limitare le informazioni false online anche se limitano la libertà di informazione".

Ma quali passi potrebbero prendere - a parte la censura e il controllo del governo - è una grande domanda.

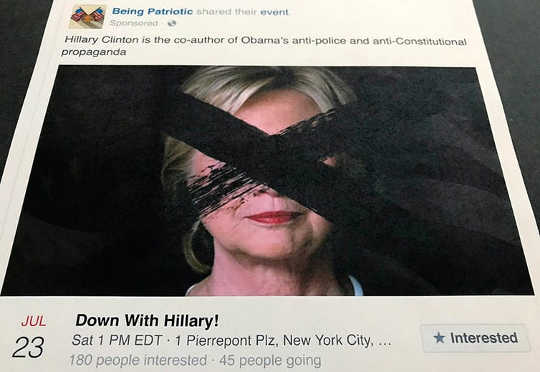

Prima di rispondere, consideriamo come si diffondono notizie false. Nelle elezioni di 2016, ad esempio, abbiamo appreso che a molta disinformazione è stato il risultato di robot russi che usato falsità cercare di esacerbare le divisioni politiche e religiose americane.

Tuttavia, i post pubblicati dai bot non significherebbero molto a meno che milioni di utenti regolari di social media scelgano di condividere le informazioni. E si scopre la gente comune diffondere disinformazione sui social media molto più velocemente e oltre le storie vere.

In parte, questo problema deriva dalle persone che condividono storie senza leggerli. Non sapevano che stavano diffondendo falsità.

Tuttavia, 14 percento degli americani intervistati in a Sondaggio 2016 segnalato consapevolmente condividendo notizie false. Ciò può essere dovuto al fatto che la ricerca mostra che le persone lo sono più probabile ingannare gli altri quando ne trae beneficio il loro partito politico o altro gruppo al quale appartengono, specialmente quando vedono altri appartenenti a quel gruppo condividere disinformazione.

Fortunatamente, le persone hanno anche un tic comportamentale che può combattere questo: vogliamo essere percepiti come onesti. La ricerca ha dimostrato che l'incentivo delle persone a mentire diminuisce quando credono che ci sia un più alto rischio di conseguenze negative, sono ricordati sull'etica, o commettere comportarsi onestamente.

Ecco perché i codici d'onore ridurre gli imbrogli e impegni di verginità ritardo insorgenza sessuale.

'Being Patriotic' era una pagina di Facebook che secondo quanto riferito era gestita da provocatori russi che cercavano di influenzare le elezioni di 2016. Ma non sarebbe andato da nessuna parte se gli utenti regolari non lo avessero condiviso. Foto AP / Jon Elswick

Prendere l'impegno

Ecco dove entra in gioco il "pegno della verità".

Sconcertato dalla disinformazione che ha caratterizzato sia le elezioni statunitensi sia Campagna Brexit nel Regno Unito, un gruppo di scienziati comportamentali dell'Università dell'Ohio e dell'Università della Pennsylvania, incluso me, voleva creare uno strumento per combattere la disinformazione. L'impegno, lanciato a dicembre 2016, è un progetto di una società no profit che ho co-fondato Intuizioni intenzionali.

L'impegno mira a promuovere l'onestà chiedendo alle persone di impegnarsi nei comportamenti 12 che la ricerca mostra correlare con un orientamento verso la verità. Ad esempio, l'impegno chiede agli acquirenti di verificare le informazioni prima di condividerle, citare fonti, chiedere ad amici e nemici allo stesso modo di ritirare le informazioni mostrate come false e scoraggiare gli altri dall'utilizzare fonti di notizie inaffidabili.

Finora, circa 6,700 persone e organizzazioni hanno preso l'impegno, incluso lo psicologo sociale americano Jonathan Haidt, Filosofo morale australiano Peter Singer, Bias dei media / Verifica dei fatti e legislatori statunitensi Beto O'Rourke, Matt Cartwright ed Marcia Fudge.

Circa 10 mesi dopo il lancio dell'impegno, i miei colleghi e io volevamo valutare se in effetti è stato efficace nel cambiare comportamento e ridurre la diffusione di notizie non verificate. Quindi abbiamo condotto due studi confrontando la condivisione degli investitori su Facebook. Per aggiungere un po 'di prospettiva esterna, abbiamo incluso un ricercatore dell'Università di Stoccarda che non ha preso parte alla creazione dell'impegno.

In uno studio, abbiamo chiesto ai partecipanti di compilare un sondaggio per valutare in che misura la loro condivisione di informazioni sulle pagine del proprio profilo e di quelle degli altri allineate con i comportamenti 12 delineati nell'impegno un mese prima e dopo averlo firmato. Il sondaggio ha rivelato cambiamenti significativi e statisticamente significativi nel comportamento, tra cui una verifica più approfondita dei fatti, un crescente riluttanza per condividere post caricati emotivamente e a nuova tendenza per respingere gli amici che condividevano informazioni.

Mentre l'auto-reporting è una metodologia ben accettata che emula l'approccio degli studi codici d'onore ed impegni di verginità, è soggetto al potenziale pregiudizio dei soggetti che segnalano cambiamenti desiderabili - come comportamenti più veritieri - indipendentemente dal fatto che questi cambiamenti siano presenti.

Quindi in a secondo studio abbiamo ottenuto il permesso dai partecipanti di osservare la loro effettiva condivisione su Facebook. Abbiamo esaminato i primi post relativi alle notizie 10 un mese dopo aver preso l'impegno e valutato la qualità delle informazioni condivise, compresi i collegamenti, per determinare quanto i loro post corrispondessero ai comportamenti dell'impegno. Abbiamo quindi esaminato i primi post 10 rilevanti per le notizie 11 mesi prima che prendessero l'impegno e li valutassero. Abbiamo nuovamente riscontrato grandi cambiamenti statisticamente significativi nell'adesione dei promotori ai comportamenti 12, come un minor numero di post contenenti disinformazione e includendo più fonti.

Chiarire la "verità"

La ragione per cui l'impegno funziona, credo, è perché sostituisce il concetto confuso di "verità", che le persone possono interpretare in modo diverso, con comportamenti chiaramente osservabili, come il controllo dei fatti prima della condivisione, la differenziazione delle opinioni dai fatti e la citazione delle fonti.

L'impegno che abbiamo sviluppato è solo una parte di uno sforzo più ampio per combattere la disinformazione. In definitiva, questo dimostra che esistono strumenti semplici che possono essere utilizzati da Facebook e da altre società di social media per combattere l'assalto di disinformazione che le persone affrontano online, senza ricorrere alla censura.

Circa l'autore

Gleb Tsipursky, Ricercatore di storia della scienza comportamentale, The Ohio State University

Questo articolo è stato pubblicato in origine The Conversation. Leggi il articolo originale.

Libri di questo autore

at InnerSelf Market e Amazon